Традиционное SEO сводилось к подбору ключевых слов и их плотности. Современные языковые модели позволяют автоматизировать анализ поисковых намерений, генерацию семантически связанного контента и адаптацию под требования алгоритмов ранжирования. Однако внедрение AI-агентов в SEO-процессы несёт операционные риски: галлюцинации моделей, дублирование контента, потеря уникальности бренда. Эта статья рассматривает архитектуру AI-пайплайнов для SEO, механизмы контроля качества, метрики эффективности и реальные ограничения технологии — без маркетинговых обещаний, с опорой на публичные исследования OpenAI, Anthropic и Stanford HAI.

Архитектура AI-пайплайна для SEO: от запроса до публикации

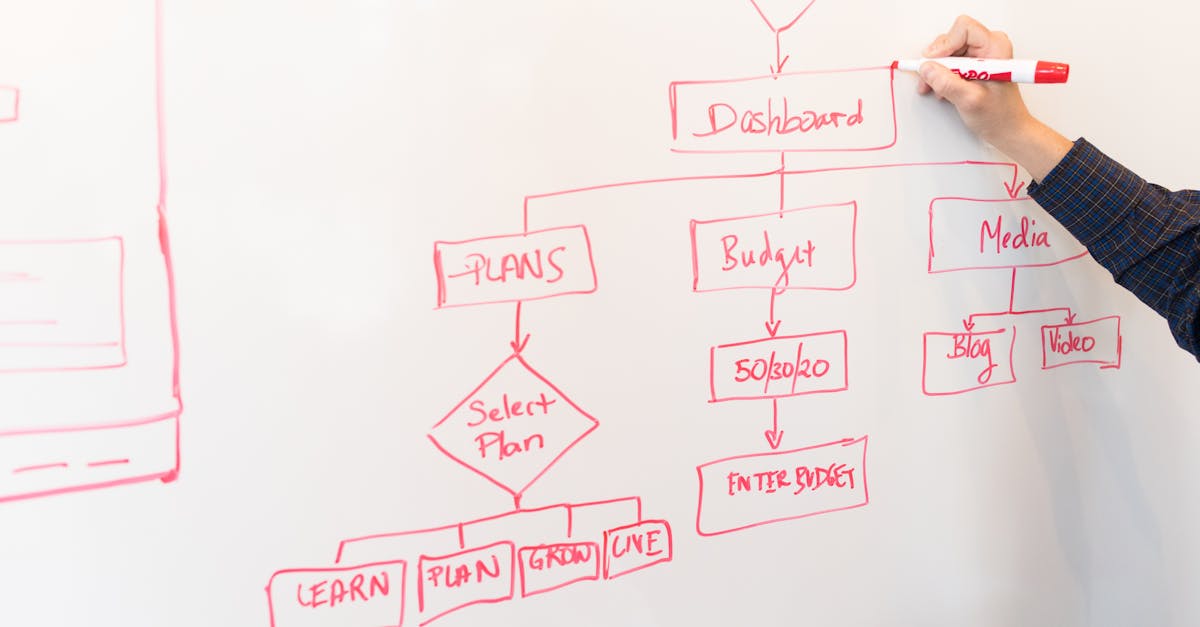

Типичный пайплайн состоит из пяти этапов. Первый — анализ поисковых запросов: агент извлекает данные из инструментов аналитики (Google Search Console API, внутренние логи), кластеризует запросы по семантике с помощью эмбеддингов (например, модели sentence-transformers). Второй — обогащение контекста через RAG: система запрашивает релевантные фрагменты из векторной базы знаний компании, чтобы минимизировать галлюцинации. Третий — генерация черновика: языковая модель (GPT-4, Claude, открытые альтернативы) создаёт текст с учётом целевых ключевых слов, структуры заголовков и читаемости. Четвёртый — валидация: автоматические проверки на дублирование (cosine similarity), фактчекинг через внешние источники, соответствие tone of voice. Пятый — публикация и мониторинг: интеграция с CMS, отслеживание позиций в реальном времени. Каждый этап требует логирования для аудита и улучшения модели. Без человеческого редактора на этапе валидации риск публикации неточного или юридически проблемного контента возрастает многократно.

Риски автоматизированной генерации: галлюцинации, дублирование, санкции

Языковые модели склонны генерировать правдоподобные, но ложные утверждения — особенно в нишевых доменах с ограниченными обучающими данными. Публикация таких текстов повреждает репутацию и может привести к юридическим последствиям. Второй риск — массовое создание похожих статей. Поисковые системы идентифицируют паттерны автоматической генерации и могут применить санкции, снизив видимость домена. Третий — потеря уникального голоса бренда: модели воспроизводят усреднённый стиль, что размывает позиционирование. Операционные меры включают: настройку temperature и top-p для контроля креативности, использование fine-tuned моделей на корпусе брендового контента, внедрение content fingerprinting для обнаружения дублей, регулярный аудит публикаций внешними экспертами. Anthropic рекомендует встраивать constitutional AI-принципы — явные инструкции модели избегать спекулятивных заявлений без источников. Без этих защитных слоёв автоматизация становится источником технического долга и репутационных потерь.

- Галлюцинации моделей: Использование RAG и цитирование источников снижает риск ложных утверждений, но не устраняет его полностью.

- Дублирование контента: Автоматический анализ cosine similarity между новыми и существующими статьями предотвращает каннибализацию ключевых слов.

- Санкции поисковых систем: Массовая публикация без редакторской проверки может быть интерпретирована как спам; A/B-тестирование небольших партий минимизирует риск.

Измеримые выгоды: скорость, охват, персонализация

При корректной реализации AI-пайплайн ускоряет производство контента в 3–5 раз по сравнению с ручным написанием. Команды могут покрывать long-tail запросы, которые ранее игнорировались из-за низкого ROI ручного труда. Персонализация — ещё одно преимущество: агенты адаптируют контент под региональные особенности, языковые варианты или сегменты аудитории, используя динамические шаблоны. Например, пайплайн генерирует варианты статьи для B2B и B2C аудиторий, изменяя терминологию и примеры. Метрики эффективности включают: прирост органического трафика (измеряется через Google Analytics 4 с атрибуцией по UTM), улучшение среднего времени на странице (показатель релевантности), снижение показателя отказов, рост числа конверсий из органики. Важно: автоматизация не заменяет контент-стратегию. Без чёткого понимания целевой аудитории и бизнес-целей даже технически совершенный пайплайн генерирует бесполезный контент. Stanford HAI отмечает, что наибольший эффект достигается в гибридных моделях, где AI обрабатывает рутинные задачи, а люди фокусируются на стратегии и креативе.

Защитные механизмы и human-in-the-loop

Критически важно встроить контрольные точки в пайплайн. Rate limiting предотвращает массовую публикацию без проверки: система ограничивает выход контента до N статей в день, направляя остальные в очередь редакторской проверки. Content moderation API (например, OpenAI Moderation) фильтрует тексты на предмет токсичности, дискриминации, юридически опасных утверждений. Fact-checking слой сравнивает сгенерированные утверждения с базой знаний или вызывает внешние API для верификации. A/B-тестирование новых статей на небольшой выборке трафика позволяет оценить влияние на метрики до полного развёртывания. Human-in-the-loop остаётся золотым стандартом: редактор проверяет финальный текст, корректирует тон, добавляет экспертные инсайты. Логирование всех решений агента (выбранные источники, промпты, версии модели) обеспечивает аудируемость и возможность rollback при обнаружении проблем. Без этих слоёв автоматизация превращается в источник риска, а не конкурентного преимущества.

- Rate limiting: Ограничение публикаций до 10–20 статей в день с обязательной очередью на редакторскую проверку.

- Fact-checking слой: Автоматическая верификация утверждений через внешние API или внутренние базы знаний перед публикацией.

- A/B-тестирование: Публикация новых статей на 5–10% трафика для оценки влияния на конверсии и показатель отказов.

Операционные рекомендации и долгосрочная стратегия

Начните с пилотного проекта: выберите одну категорию контента (например, FAQ или описания продуктов) и автоматизируйте её, сохраняя ручной контроль над стратегическими материалами. Измеряйте baseline-метрики до внедрения и сравнивайте результаты через 3–6 месяцев. Инвестируйте в обучение команды: редакторы должны понимать ограничения LLM и уметь корректировать промпты. Используйте fine-tuning только при наличии достаточного корпуса качественного контента (минимум 500–1000 примеров). Регулярно обновляйте векторные базы знаний, чтобы RAG-система оперировала актуальными данными. Мониторьте изменения алгоритмов поисковых систем: Google регулярно обновляет критерии оценки качества контента, и пайплайн должен адаптироваться. Долгосрочная стратегия — не полная замена людей, а перераспределение усилий: AI берёт на себя масштабирование и рутину, люди концентрируются на экспертизе, креативе и стратегическом планировании. Это операционная модель, требующая постоянной калибровки.

Заключение

AI-автоматизация SEO открывает возможности для масштабирования контента, покрытия long-tail запросов и персонализации под сегменты аудитории. Однако технология не является серебряной пулей: галлюцинации моделей, риски санкций поисковых систем и потеря уникальности бренда требуют многослойных защитных механизмов. Успешные внедрения сочетают RAG-пайплайны, автоматические проверки качества и обязательную редакторскую проверку. Метрики эффективности — органический трафик, время на странице, конверсии — должны отслеживаться в долгосрочной перспективе. Автоматизация эффективна как инструмент оптимизации операций, но не заменяет контент-стратегию и экспертное суждение. Операторам следует начинать с пилотных проектов, измерять результаты и итеративно улучшать пайплайн.

Дмитрий Соколов

Дмитрий специализируется на проектировании агентных пайплайнов для контент-операций и анализа данных. Работал над внедрением RAG-систем в медиа и e-commerce, публикует исследования по надёжности LLM-приложений.